近日,京东探索研究院正式开源多模态基础模型JoyAI-Image-Edit,支持文生图、图像理解以及指令引导的图像编辑。该模型不仅具备像素级精细化编辑能力,更能赋予平面图像真实的'立体感',是业内首个将空间智能深度融入统一多模态框架的开源模型,在引入空间能力的同时,依然具备强大的通用生成与理解性能。

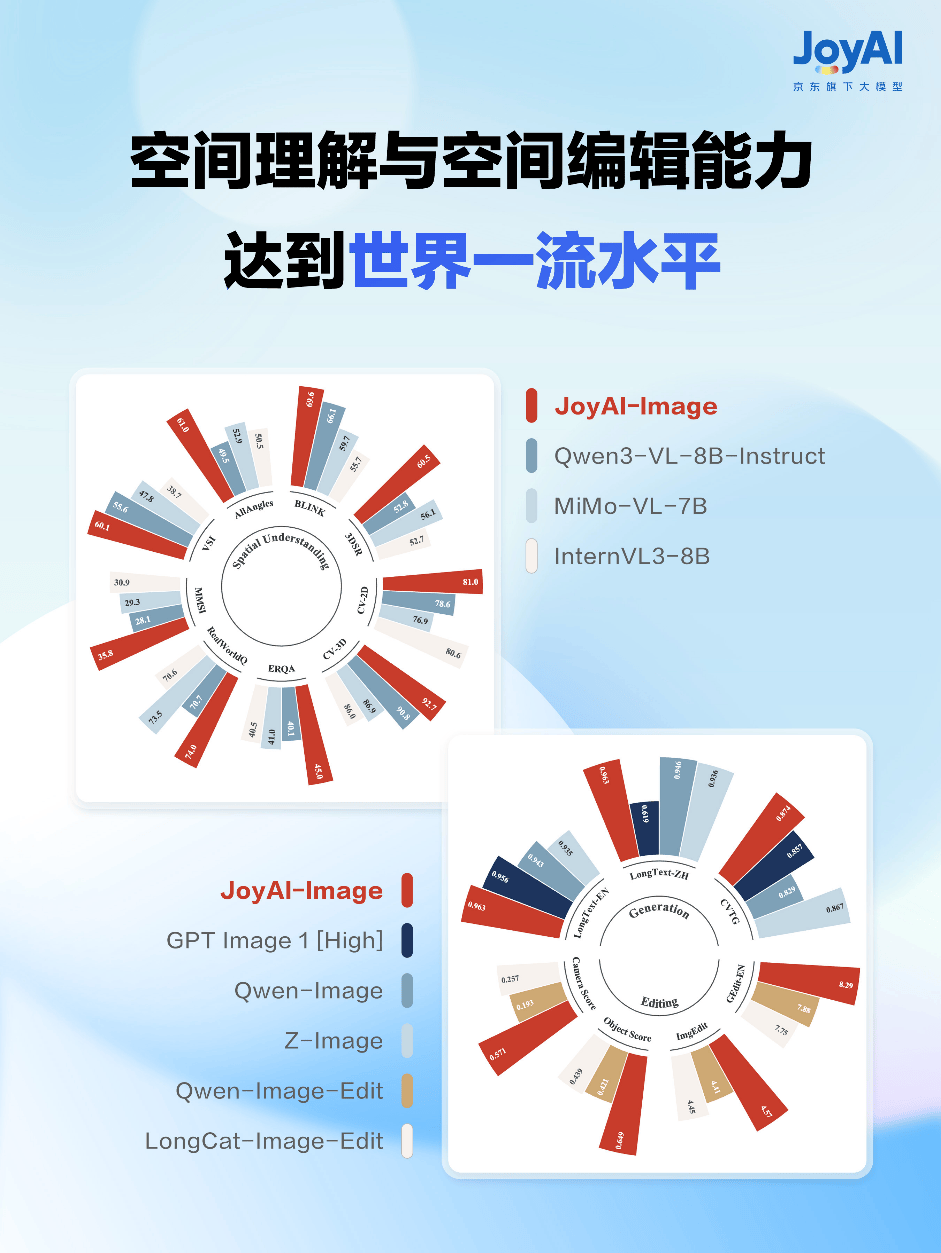

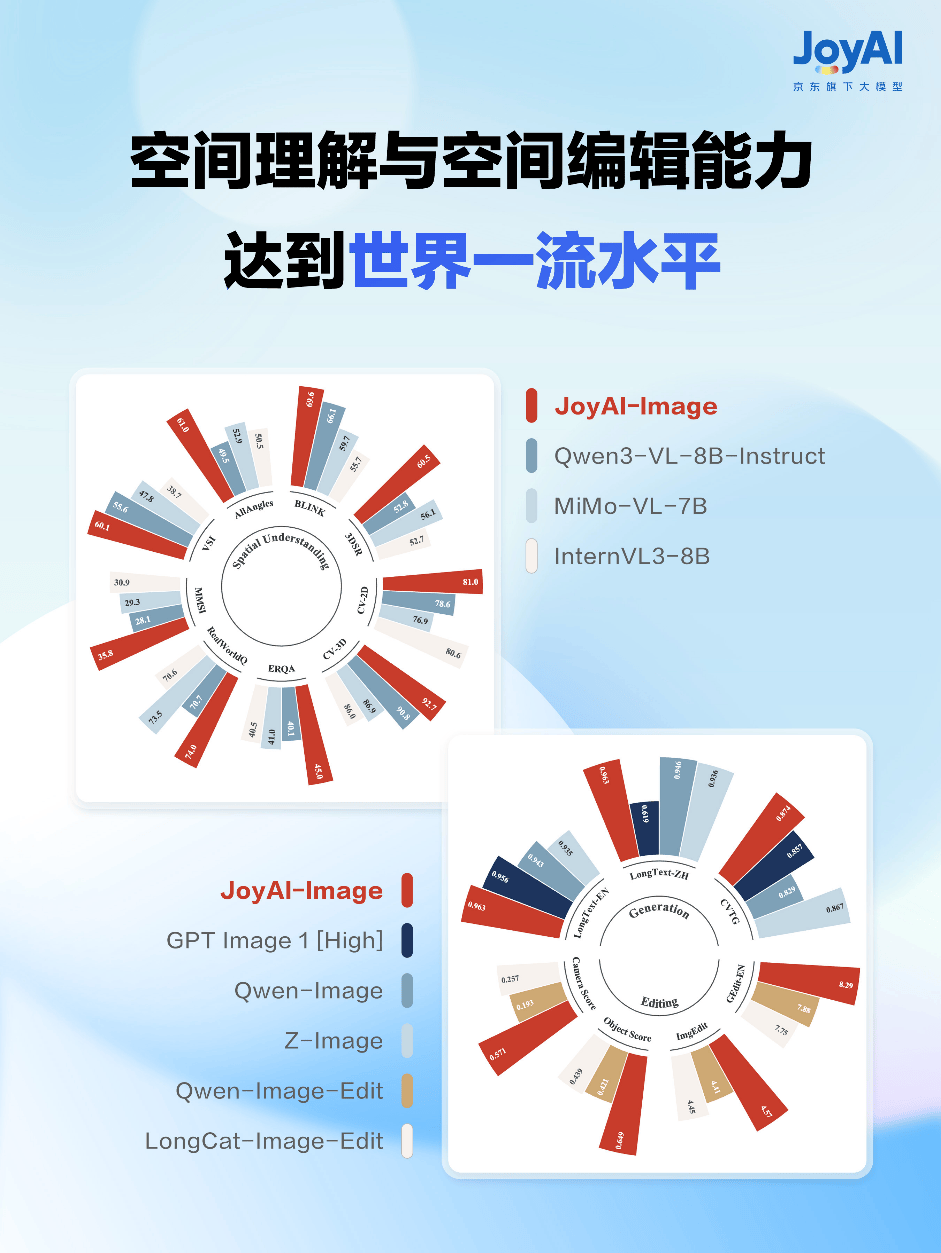

在公开的Benchmark中,JoyAI-Image-Edit的空间理解和空间编辑能力已达世界一流水平,超过现有开源模型,比肩顶尖闭源模型。

目前,模型已开源,开发者可直接基于其构建空间编辑应用。

JoyAI-Image-Edit的空间理解和空间编辑能力已达世界一流水平

破局行业痛点:理解与生成之间的“空间断层”

统一多模态模型是当前学界和产业界共同攻坚的方向,不少头部公司都在尝试将图像理解与生成整合进同一个模型框架。然而,理解与生成的协同在空间维度上存在明显短板。

这种短板在实际编辑中暴露得尤为突出:移动物体导致结构变形、比例失调;调整物体间的位置关系则遮挡层次全部错乱;切换视角时透视几何严重失真;反复微调后画面一致性彻底崩塌。根源在于模型缺乏对三维空间结构的深层理解,理解模块输出的语义信息没有真正'流入'生成模块的几何控制过程,编辑操作只是在像素层面'搬运',而非在空间层面'推理'。

JoyAI-Image-Edit正是为此而生——从数据构建、任务设计到训练策略全链路注入空间感知,让理解、生成与编辑在统一框架内彼此增强。

三大核心亮点:从架构到场景的全面突破

JoyAI-Image-Edit的技术优势集中体现在三个层面。 第一,生成与理解的深度融合。模型采用MLLM–MMDiT统一架构,彻底打破了理解与生成的边界。通过视觉感知

在公开的Benchmark中,JoyAI-Image-Edit的空间理解和空间编辑能力已达世界一流水平,超过现有开源模型,比肩顶尖闭源模型。

目前,模型已开源,开发者可直接基于其构建空间编辑应用。

JoyAI-Image-Edit的空间理解和空间编辑能力已达世界一流水平

破局行业痛点:理解与生成之间的“空间断层”

统一多模态模型是当前学界和产业界共同攻坚的方向,不少头部公司都在尝试将图像理解与生成整合进同一个模型框架。然而,理解与生成的协同在空间维度上存在明显短板。

这种短板在实际编辑中暴露得尤为突出:移动物体导致结构变形、比例失调;调整物体间的位置关系则遮挡层次全部错乱;切换视角时透视几何严重失真;反复微调后画面一致性彻底崩塌。根源在于模型缺乏对三维空间结构的深层理解,理解模块输出的语义信息没有真正'流入'生成模块的几何控制过程,编辑操作只是在像素层面'搬运',而非在空间层面'推理'。

JoyAI-Image-Edit正是为此而生——从数据构建、任务设计到训练策略全链路注入空间感知,让理解、生成与编辑在统一框架内彼此增强。

三大核心亮点:从架构到场景的全面突破

JoyAI-Image-Edit的技术优势集中体现在三个层面。 第一,生成与理解的深度融合。模型采用MLLM–MMDiT统一架构,彻底打破了理解与生成的边界。通过视觉感知